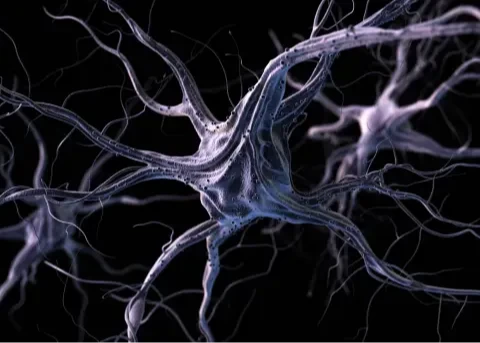

Las redes neuronales son estructuras fundamentales en el campo de la inteligencia artificial y la ciencia de la computación, diseñadas para simular el funcionamiento del cerebro humano. Estas poderosas herramientas se utilizan para llevar a cabo una variedad de tareas, desde reconocimiento de patrones hasta procesamiento de lenguaje natural, aprovechando su capacidad para aprender y adaptarse a partir de datos.

En su esencia, las redes neuronales están compuestas por unidades básicas llamadas neuronas, organizadas en capas interconectadas. Estas capas pueden dividirse en tres categorías principales: la capa de entrada, donde se introducen los datos; las capas ocultas, que procesan la información; y la capa de salida, que produce el resultado final. La información fluye a través de estas capas, y cada conexión entre neuronas tiene un peso que determina la importancia de la información que lleva.

El aprendizaje de una red neuronal implica ajustar estos pesos para que la red pueda

realizar la tarea deseada de manera más precisa. Este proceso se lleva a cabo a través de

fases de entrenamiento y prueba. Durante el entrenamiento, la red se expone a un conjunto

de datos junto con las salidas deseadas, y algoritmos de optimización ajustan los pesos

para minimizar la diferencia entre las salidas reales y las deseadas. Una vez entrenada, la

red puede generalizar y realizar predicciones o clasificaciones para nuevos datos durante la

fase de prueba.

Un tipo común de red neuronal es la red neuronal artificial de alimentación hacia adelante (feedforward). En esta arquitectura, la información se mueve en una dirección, desde la capa de entrada hasta la capa de salida, sin ciclos o bucles en la red. Sin embargo, las redes neuronales recurrentes (RNN) introducen conexiones cíclicas, permitiendo que la información persista a lo largo del tiempo, lo que las hace adecuadas para tareas que implican secuencias de datos